Auf der WWDC 2024 hat Apple zum ersten Mal den eigenen Ansatz zum Thema Künstliche Intelligenz vorgestellt: Apple Intelligence. Der Konzern bringt damit eine ganz neue Art von KI, sogenannte persönliche Intelligenz, auf iPhone, iPad und Mac und definiert dabei einen neuen Standard in Bezug auf Datenschutz, Sicherheit und Privatsphäre.

Und auch wenn die aktuell vorgestellten Funktionen vielleicht nicht so spektakulär sind und auch die Verfügbarkeit noch nicht wirklich groß sehen wir hier vermutlich den nächsten, logischen Schritt in der Weiterentwicklung des Themas Künstliche Intelligenz im Gesamten. Weg von begrenzten Chatbots und hin zu einer wirklichen, persönlichen Assistenz in Beruf und Alltag.

Neue KI-Funktionen von Apple

In der Präsentation lag der Fokus im Teil über die neuen KI-Funktionen vor allem auf Dingen, die vielleicht auf den ersten Blick doch etwas unwichtig oder unbeeindruckend wirken. Wir können jetzt mit Genmoji eigene Emojis erstellen, oder Bilder in den drei Stilen Illustration, Animation oder Skizze erstellen.

Wir wollen uns hier jetzt mehr darauf konzentrieren, was dahinter steckt, in welche Richtung das Thema Künstliche Intelligenz bei Apple geht und ich will damit beginnen, dass ich mir drei Teile herausgepickt habe, die wirklich einmal zu Ende gedacht worden sind, beginnend mit Writing Tools.

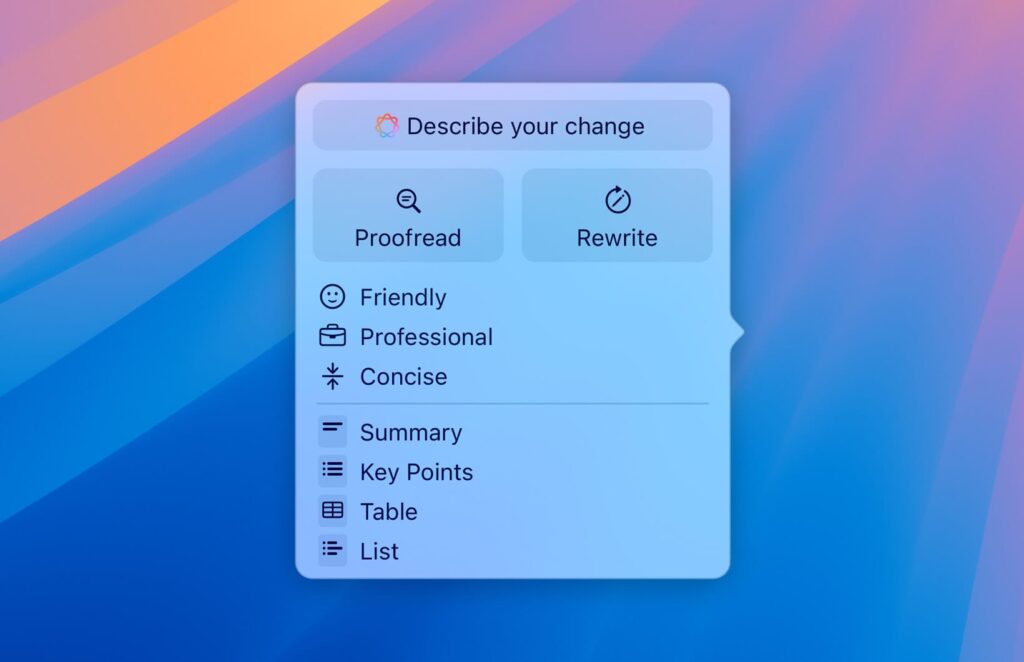

Writing Tools als Unterstützung beim Schreiben

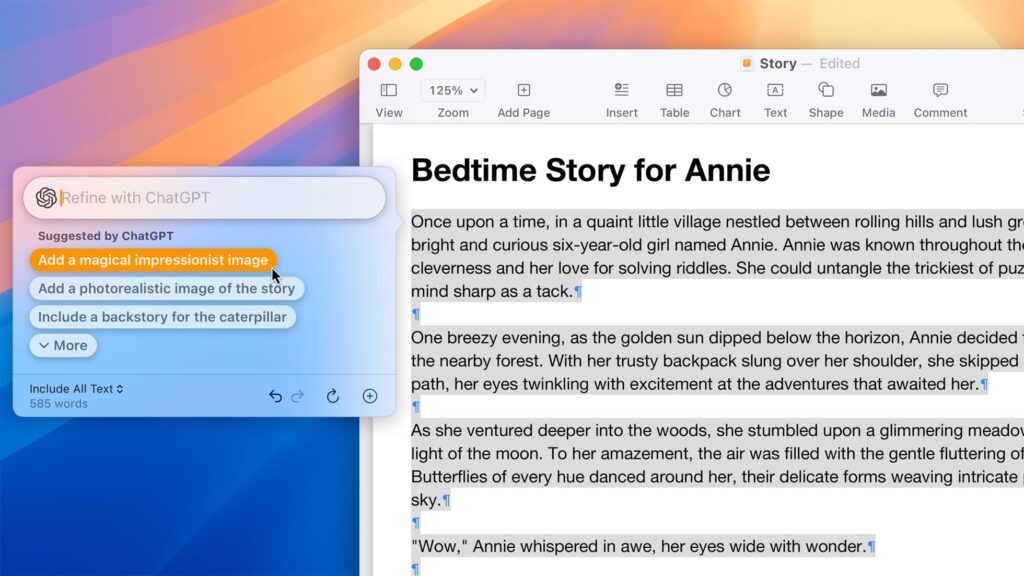

Das klingt erst einmal auch eher unspektakulär und sieht auch so aus, das kleine KI-Popup mit verschiedenen Optionen zum Umschreiben oder Korrekturlesen lassen durch Künstliche Intelligenz. Diese Dinge haben viele von uns auch beim Copilot schon gesehen oder bei Googles Gemini.

Der Unterschied ist: Writing Tools von Apple ist kein Zusatzfeature für Mail, oder die Notiz-App. Es ist ein Teil der gesamten Betriebssysteme. Überall dort, wo ich einen Cursor habe, wo ich Text schreiben kann, stehen mir diese Werkzeuge zur Verfügung – sogar in Apps, die nicht von Apple kommen. Also egal, ob ich eine Nachricht in Mail verfasse, oder auf einer Website etwas kommentieren – die KI kann mich beim Schreiben unterstützen.

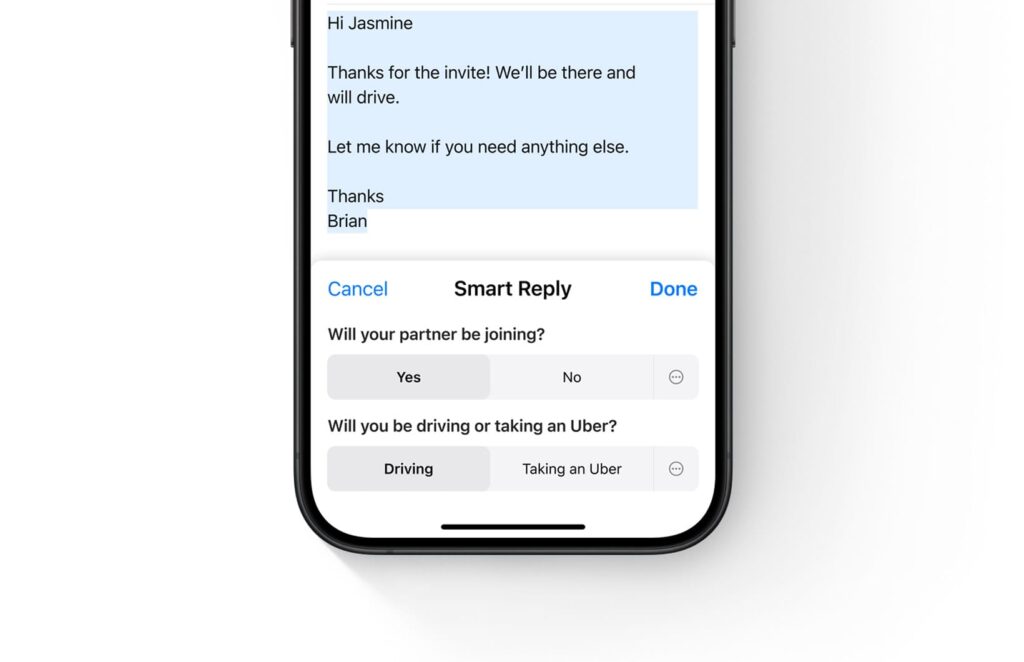

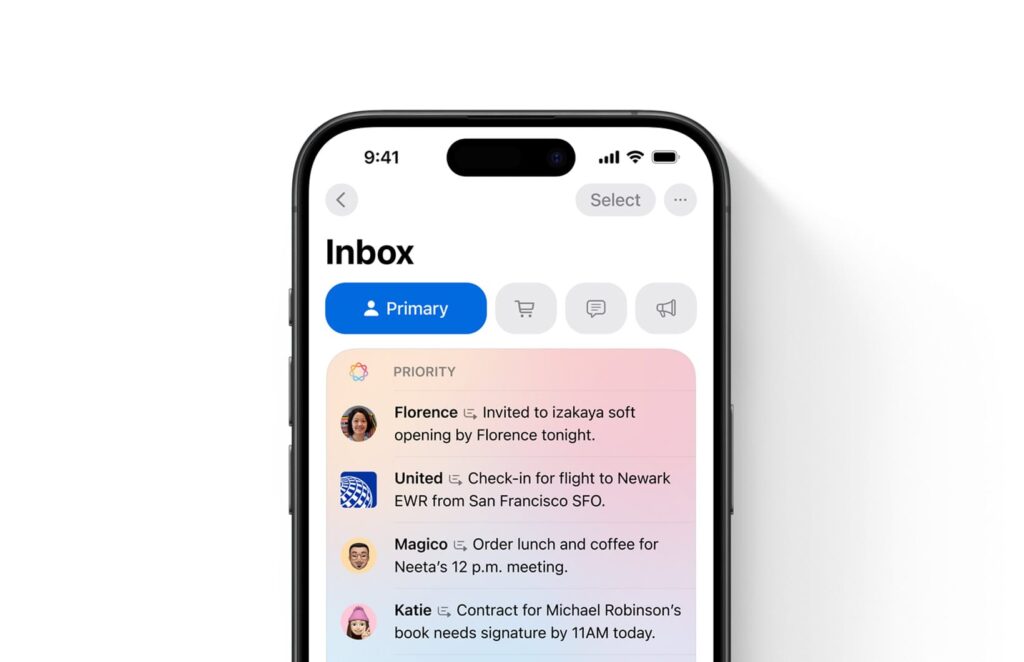

Smart Reply und Email Summaries in der Mail App

Aktuell nur auf die eigene Mail-App beschränkt aber trotzdem beeindruckend sind die Funktionen Smart Reply und Email Summaries. Bei Smart Reply werden mir beispielsweise zu einer Email automatisch Antwortmöglichkeiten vorgeschlagen. Aber anstatt dann noch selbst einen Prompt schreiben zu müssen, was ich gerne antworten möchte wie beispielsweise im Microsoft Copilot in Outlook erkennt Smart Reply Fragen aus der Mail und ich muss nur noch kurz anklicken, was meine Antworten darauf sind und schon bin ich fertig.

Email Summaries ersetzen automatisch und ohne weitere Prompts oder Klicks den in aller Regel nicht besonder aufschlussreichen Vorschautext meiner Mails mit kurzen, knappen Zusammenfassungen, sodass man direkt aus der Mail-Übersicht schnell scannen kann, ob eine Nachricht wichtig oder unwichtig ist.

Persönliche Intelligenz mit Apple Intelligence

Aber gehen wir jetzt einmal weg von individuellen Features und werfen einen Blick darauf, wie Apple das ganze Thema KI angeht. Ein Begriff, den wir hier vermutlich jetzt häufiger hören werden, ist Personal Intelligence also persönliche Intelligenz und das ist im Prinzip die logische Weiterentwicklung, bzw. einfach allgemein der nächste Schritt für künstliche Intelligenz in unserem Alltag.

Klar, die guten Chatbots, egal ob ChatGPT, Claude oder auch Copilot oder Gemini können auf bestimmte Anfragen gute Antworten liefern und uns kleine Aufgaben immer mal wieder abnehmen – aber wenn man ehrlich ist, ist die Integration dieser Chatbots in wirkliche Arbeitsabläufe oder sogar unseren Alltag nicht besonders praktisch oder intuitiv.

Wir reden viel mit anderen Personen, die sich intensiv mit dem Thema künstliche Intelligenz beschäftigen und man merkt schon so langsam, dass sich viele eine Weiterentwicklung wünschen in Richtung einer wirklichen persönlichen Assistenz durch KI. Eigentlich ein System, das wirklich Bescheid weiß darüber, was ich gerade mache, was meine Aufgaben und Ziele sind und mich aktiv dabei unterstützen kann.

Apple Intelligence ist von Grund auf so aufgebaut, dass aus Daten von Kontakten, aus Nachrichten, Fotos, Dokumenten und Dateien ein echter Bezug und Kontext über einen selbst gebildet werden kann, der der KI dabei hilft uns besser zu verstehen und auch unsere Anfragen entsprechend zu beantworten und umzusetzen.

Es wird ein app-übergreifendes System erstellt, Betriebssystem und individuelle Apps können zusammenarbeiten, um ein gewünschtes Ziel zu erreichen – also ein komplett anderer Ansatz als eine “Apple Intelligence”-App als zentralen Chatbot oder Kommandozentrale.

Und natürlich muss man sagen: Apple hat es hier erst einmal leicht, denn man hat eben die volle Kontrolle über alle eigenen Systemapps, egal ob Mail, Nachrichten, Karten, Fotos oder Apple Music. Aber durch diese Kontrolle funktioniert das System auch sehr gut. Es geht darum im gewohnten Apple-Stil eine intuitive Bedienung zu bieten. User sollen sich keine Gedanken um den perfekten Prompt machen müssen, die KI passt sich den Bedürfnissen an und nicht anders herum.

In diesem Beispiel mit der neuen Version von Siri wird schön gezeigt, wie dieses Zusammenspiel von Sprachsteuerung, KI und verschiedenen Apps funktionieren kann.

Auch wenn einen das auf den ersten Blick jetzt wirklich nicht vom Hocker haut, denke ich die Richtung ist klar. KI sollte keine extra App sein, keine extra Anlaufstelle, wo ich mir etwas generieren kann und es dann wieder kopieren muss und dort einfügen, wo ich es eigentlich haben wollte. KI soll mich genau da unterstützen, wo ich gerade Hilfe brauche.

Jetzt kommen wir aber zum Problem: Ich will das alles so haben, aber gleichzeitig soll natürlich niemand alle meine Daten bekommen, über meine Kontakte Bescheid wissen und meine Dokumente lesen können. Wie sieht es bei Apple Intelligence denn damit aus?

Datenschutz und Privatsphäre

Das ist vermutlich der wichtigste Punkt und ein Thema das von Apple schon immer die größte Priorität zugeschrieben bekommen hat: Datenschutz und Privatsphäre. Interessanterweise ist das eben auch genau das Thema, das uns beim Thema KI ja oft doch Kopfschmerzen bereitet und viele der aktuell verfügbaren Tools und Anbieter sind in Bezug darauf doch eher undurchsichtig und man weiß nicht so recht, was eigentlich mit den Informationen, die man beispielsweise bei einem Chatbot eingibt, eigentlich passiert.

Die KI von Apple besteht im Prinzip aus drei Teilen: einem kleinen Modell, das auf dem jeweiligen Gerät läuft und das Anfragen ohne jede Verbindung zu einem Server bearbeitet. Einem größeren Modell, das für kompliziertere Anfragen herangezogen wird und in einem eigenen, neuen Server-Netzwerk mit dem Namen Private Cloud Compute läuft und – optional – einer Weitergabe von Anfragen an andere Modelle außerhalb des Apple-Ökosystem. Dazu aber gleich mehr, jetzt beschränken wir uns zunächst auf die Apple-Modelle und deren Sicherheit in Bezug auf unsere Daten.

Zum Modell auf dem Gerät muss man nicht viel sagen – keine Daten verlassen das iPhone, Tablet oder den Mac und damit haben wir maximale Privatsphäre, die den üblichen Apple Standards entspricht.

Was die Leistung des Modells angeht, gibt es natürlich noch nicht viele unabhängige Tests, aber in den Benchmarks von Apple sieht man, dass wir hier auf dem Gerät uns vermutlich auf einem etwas besseren Niveau befinden, als das momentan der Fall ist bei vergleichbaren Modellen von Google oder Mistral.

Aber was ist jetzt mit den Modellen, die nicht ausschließlich auf dem Gerät laufen?

Auch die Verwendung des Private Cloud Compute Netzwerks ist extrem sicher und anonym. Dieses Netzwerk läuft komplett auf Apple Rechnern, mit den eigenen Chips und der Konzern hat auch hier dafür gesorgt, dass unsere Daten unsere Daten bleiben.

Das komplette Server-Netzwerk wird von unabhängigen Expertinnen und Experten auf diese Datensicherheit geprüft und es wird kryptografisch dafür gesorgt, dass Apple Geräte die Verbindung zu einem Server ablehnen, wenn dessen Software Protokolle nicht öffentlich prüfbar sind.

An dieser Stelle zitieren wir jetzt fast Apple selbst, aber da muss man schon ganz ehrlich sagen, dass diese Infrastruktur wirklich einen neuen Standard für Datenschutz im Bereich Künstliche Intelligenz definiert.

Integration von ChatGPT und Partnerschaft mit OpenAI

Ein Punkt, der mit Spannung erwartet wurde und dann auch kam ist die Integration von ChatGPT und die Partnerschaft von Apple mit OpenAI. Apple Intelligence wird automatisch Anfragen identifizieren, die von ChatGPT gut beantwortet werden können und Usern dann die Möglichkeit geben die KI von OpenAI zu verwenden. Dabei wird ausdrücklich jedes Mal nachgefragt, ob die Anfrage oder auch Anhänge wie Bilder an ChatGPT gesendet werden sollen und man muss dem natürlich nicht zustimmen.

Auch bei dieser Integration stellt Apple Datenschutz und Privatsphäre in den Vordergrund. Man benötigt keinen Account bei ChatGPT, um die KI zu nutzen, die IP-Adressen werden verschlüsselt, sodass Anfragen nicht einer Person oder einem Gerät zuzuordnen sind und keine der Daten werden bei OpenAI gespeichert.

Wer einen Premium-Account bei ChatGPT hat, kann diesen verknüpfen und verwenden, um auch die ensprechenden Funktionen zu nutzen, in diesem Fall werden die Daten normal behandelt, also im Prinzip als würde man die ChatGPT App auf dem iPhone nutzen.

Wann kann ich Apple Intelligence verwenden?

Kommen wir jetzt zu dem Thema, dass vermutlich alle brennend interessiert und bei dem es aktuell leider noch einen kleinen Dämpfer gibt: Apple Intelligence wird dieses Jahr für die Sprache US-Englisch auf iPhone 15 Pro und Pro Max sowie allen iPads und Macs mit einem M1-Chip oder neuer verfügbar sein. Mehr Funktionen und auch anderen Sprachen sind erst für nächstes Jahr geplant. Es handelt sich aber ausdrücklich nicht um eine Länderbeschränkung, das bedeutet, wenn wir hier Siri und die Systemsprache unserer Geräte auf US-Englisch stellen, dann können auch wir die neuen Funktionen verwenden und Apple Intelligence ausprobieren.

Die Integration von ChatGPT wird mit den neuen Software-Versionen iOS 18, iPadOS 18 und macOS Sequoia im Herbst diesen Jahres kommen.

Wie geht es mit Apple Intelligence weiter?

Aktuell wissen wir sicher von der Existenz von mindestens vier eigenen Apple KI-Modellen, die die neuen Fähigkeiten unterstützen: Ein 3B Modell, das für Operationen auf dem Gerät verwendet wird und ein größeres LLM für Private Cloud Compute, also die Anfragen über Apple Server. Außerdem gibt es ein spezielles Coding-Modell, das Intelligenz auch in die Entwicklersoftware Xcode von Apple bringen soll und ein Diffusion-Modell für die Bilderzeugung.

Das ist aber nicht alles, Apple hat vor allem in letzter Zeit viele kleine Tools und Modelle entwickelt, zum Beispiel für die Erkennung und Verwendung von Elementen auf dem Bildschirm, um der eigenen KI den bestmöglichen Kontext zu geben und diese Entwicklung wird sicherlich weitergehen. Wir stehen jetzt am Start der Apple KI-Welt und da der Konzern wirklich alle Teile selbst kontrolliert werden wir hier sicherlich noch die ein oder andere Innovation erleben.

Aber auch was die Integration der bestehenden Tools und fähigen KI-Modelle angeht, ist wohl noch nicht Schluss. Apple beginnt die Partnerschaften mit OpenAI, Integrationen von anderen Modellen, egal ob Gemini, Claude oder andere sind definitiv nicht ausgeschlossen und auch hier sind wir gespannt.

Und schließlich wird es interessant, wie weit wir mit KI-Funktionen auch in Apps von Drittanbietern rechnen dürfen. Für fast alle der neuen Möglichkeiten wurden und werden jetzt während der WWDC neue APIs, also Schnittstellen für Entwicklerinnen und Entwickler vorgestellt, mit denen sie ihre eigenen Apps in dieses vernetzte System integrieren können.

Unsere Einschätzung zu Apple Intelligence

Qualität statt Quantität. Apple spielt mit Apple Intelligence wieder einen entscheidenden Vorteil aus und zwar das geschlossene Ökosystem in dem sie arbeiten. Hard und Software kommt beides von einem Unternehmen. Das Unternehmen kontrolliert, welche Geräte Zugriff auf die neue Technologie bekommen, und beschränkt sich dabei auf die Geräte, von denen es sicher sein kann, dass es reibungslos funktioniert. Diese Herangehensweise wird zu einer enormen Zufriedenheit bei der Nutzererfahrung sorgen und Frustrationen von Nutzern aufgrund von minderwertiger Hardware vermeiden.

Das wird wiederum die Wahrnehmung der Marke im Bereich KI stärken und persönlich bin ich der Meinung, dass man eher dazu neigt einem Unternehmen ein fehlendes Feature zu verzeihen, als eins das vorhanden ist aber einfach schlecht funktioniert, siehe die Erfahrung, die Google mit seinen AI Overviews gemacht hat.

Ganz abgesehen davon drängt man die User natürlich auch zu einem gewissen Grad dazu im Apple Ökosystem zu bleiben, schließlich möchte ich die KI Unterstützung dann nicht nur auf dem Handy haben sondern im besten Fall auch auf meinem Computer, im Auto und im Zweifel auch auf meiner Uhr.

Alles in Allem muss man sagen, dass Apples vorsichtige und überlegte Strategie zumindest momentan aufzugehen scheint. Man hat sich darauf konzentriert, die Technologie KI zu nutzen und nicht unter Druck ein eigenes Tool auf den Markt geworfen, das nichts neues kann und einfach nur eines unter vielen ist. Neben den Verbesserungen für die Bedienbarkeit der Geräte hat man mit OpenAI auch noch den passenden Partner gefunden, für diejenigen, die einen bequem integrierten Chatbot nutzen möchten.

Das man für die Gratisvariante als iPhone-User nicht mal einen Account bei ChatGPT braucht ist natürlich ein Riesenvorteil und in Zeiten in denen Firmen wie Meta mit schlechter Presse kämpfen, weil sie ihre Modelle mit Nutzerdaten trainieren möchten, kann Apple mit extrem hoher Privatsphäre punkten.

Aber auch wenn es nachvollziehbar ist, dass nur die Flagschiffmodelle Zugriff auf die KI Features bekommen ist es natürlich auch ein Nachteil, den Apple hier in Kauf nimmt, da sich nur ein kleiner Prozentsatz von iPhone-Käufen auf die teuersten Modelle verteilt und man zumindest für den Moment einen Großteil der Nutzer ausschließt.

Wie gesagt ist das aber ein bewusster Schritt und man wird aufgrund dieser selbstauferlegten Einschränkung gezielter Daten und Feedback sammeln können und dann perspektivisch die Funktionen insofern verbessern, dass sie möglicherweise auch auf schwächeren Chips laufen.

Alternativ haben wir als User auch immer die Möglichkeit auf Drittanbieter wie OpenAI oder Google zurückzugreifen. Apple schränkt uns also nicht bei der Wahl unserer KI-Tools ein, sondern bietet uns mit Apple Intelligence einfach nur eine Unterstützung bei der Verwendung unserer Geräte und das zeichnet diesen Schritt eben auch aus. Apple geht gar keine Konfrontation mit den aktuell wichtigsten KI-Unternehmen ein, sondern präsentiert KI-Entwicklungen in einer ganz eigenen Kategorie.

Auch wenn wir bei der Microsoft Konferenz einige KI-Features für die nächste Generation von Surface PCs gesehen haben, wirken diese stellenweise doch eher wie Fremdkörper, die sich nicht nahtlos in die Bedienung einfügen. Als Beispiel kann man hier das Recall Feature nehmen, dass unsere gesamte Interaktion mit dem PC aufzeichnet und uns ermöglicht in unserem Alltag “zurückzuspulen”. Auch wenn Microsoft hier eine beeindruckende Funktion vorgestellt hat, waren die Reaktionen darauf gelinde gesagt gemischt. Sorgen vor Überwachung durch das Windows Unternehmen und Privatsphäre wurden laut und das ist natürlich auch Apple nicht entgangen.

Deshalb sind die Vorstellungen vom iPhone Konzern vielleicht nicht so spektakulär, wie man es in den letzten Monaten bei anderen Firmen gesehen hat, aber sie wirken unaufgeregt und souverän.

Während dem ganzen KI-Boom konservativ zu agieren ist gegenüber den eigenen Stakeholdern mit Sicherheit nicht einfach, aber es kann sich auf lange Sicht auszahlen, die eigenen Kunden nach und nach auf die KI-Wende vorzubereiten und Schritt für Schritt an das Thema heranzuführen, anstatt sie mit einer kompletten Umstellung der Nutzererfahrung zu konfrontieren.