Gesponserter Beitrag: Zusammenarbeit mit der Europäischen Kommission

In diesem Artikel beschäftigen wir uns mit dem neuen KI-Gesetz der EU und sprechen darüber weshalb Vorgaben und Regeln ein wichtiger Schritt ist, um sichere Anwendungen von künstlicher Intelligenz, Akzeptanz der Technologie in der Gesellschaft und damit letztendlich auch Innovation und Weiterentwicklung für uns alle sind.

Ein ganz wichtiger Hinweis in Bezug auf Transparenz zu Beginn: Dieser Artikel und das dazugehörige Video auf YouTube sind in Zusammenarbeit mit der Europäischen Kommission entstanden, als Teil der Kampagne #AIinEurope und sind damit eine bezahlte Kooperation. Trotzdem hatten wir bei unserer Recherche und dem Erstellen der Skripte freie Hand.

Was ist das KI-Gesetz eigentlich und was steckt dahinter?

Die EU hat als erste Organisation weltweit ein umfassendes Gesetz zur Regulierung von KI auf den Weg gebracht. Das Ziel dieses sogenannten AI Acts – wir sagen auf deutsch einfach KI-Gesetz dazu – ist es einen rechtlichen Rahmen für die Entwicklung und Nutzung von KI-Systemen zu schaffen.

Eine Befürchtung im Zusammenhang mit solchen Regelungen ist natürlich immer, dass der Fortschritt gebremst wird, indem Technologien verboten oder zu sehr eingeschränkt werden. Es geht beim KI-Gesetz aber einfach darum, dass so viele Menschen wie möglich von KI profitieren – ohne dabei die eigenen Rechte oder die eigene Sicherheit aufs Spiel zu setzen.

Wie möchte die EU das umsetzen?

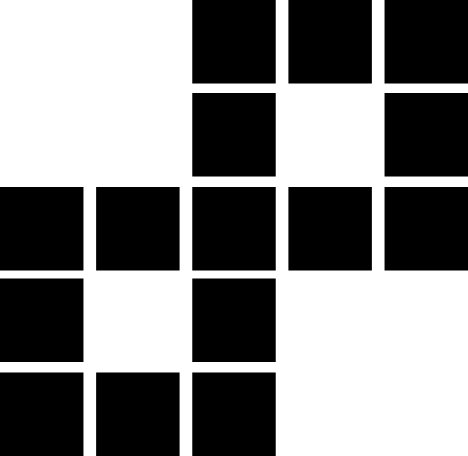

KI-Systeme sollen nach ihrem Risiko in vier verschiedene Stufen eingeteilt werden.

Inakzeptable Risiken

Ganz oben in der Pyramide stehen inakzeptable Risiken und diese Systeme sind komplett verboten. Das klingt hart, aber ist gerade im Bereich KI absolut notwendig. In diese Kategorie fallen Anwendungen wie soziale Bewertungssysteme, wie man sie aus Science Fiction Serien wie “Black Mirror” kennt. In denselben Bereich fällt auch beispielsweise teilweise die Life-Gesichtserkennung im öffentlichen Raum. Auch wenn solche Systeme aktuell bei uns nicht existieren, ist es auf jeden Fall gut, das auch für die Zukunft zu unterbinden.

Was viele gar nicht wissen, ist dass auch moderne Smartphones bereits KI verwenden, um das Handy mit dem Gesicht zu entsperren.Das wird natürlich nicht verboten. Was verboten wird ist polizeiliche Massenüberwachung.

Hochrisiko-KI

Als nächstes gibt es die Kategorie der Hochrisiko-KI. Anwendungen, die in diese Kategorie fallen sind nicht verboten, aber müssen bestimmte Qualitätsanforderungen erfüllen und geprüft werden, ähnlich wie es bei anderen IT-Produkten oder Abteilungen auch heute schon der Fall ist.

Diese Kategorie betrifft vor allem Bereiche, die wichtig für unser Leben sind. Stellen wir uns vor, eine KI entscheidet darüber, ob ich einen Studienplatz oder einen Job bekomme. Oder ein KI-System in einem Krankenhaus stellt Diagnosen und Behandlungsempfehlungen aus. Dass hier nur qualitativ hochwertige Systeme auf den Markt kommen dürfen und ich nicht meine Zukunft oder Gesundheit einem Softwareprodukt ohne jegliche Rechtfertigung ausliefern will – damit sind wir denke ich doch alle einverstanden. Dasselbe gilt natürlich auch für den Einsatz von KI beispielsweise in der Strafverfolgung, wenn Beweise möglicherweise aus KI-Analysen entstehen.

„Transparency Risk“ – Kennzeichnung und Transparenz

Die dritte Kategorie heißt im englischen “Transparency” Risk und beinhaltet Systeme mit etwas anderem Risikopotenzial. Darunter fallen beispielsweise auch viele Chatbots. Hier gelten entschärfte Transparenzregeln im Vergleich zur Prüfungspflicht bei der Hochrisiko-KI.

Das kann zum Beispiel einfach der Hinweis sein, dass man gerade mit einer KI spricht, wenn man ein Chatfenster benutzt oder ein entsprechendes Label oder eine Kennzeichnung, wenn ein Inhalt mithilfe von KI erzeugt wurde. Gerade in Zeiten, in denen Deepfakes und manipulierte Bilder und sogar Videos durch die Fortschritte in der Technologie wieder auf dem Vormarsch sind, muss man unserer Meinung nach auch diese Kennzeichnungspflichten auf jeden Fall begrüßen. So kann eben nicht einfach jeder machen, was er oder sie möchte und gezielt glaubhafte Falschinformationen verbreiten.

Minimales Risiko

Es gibt außerdem noch eine letzte Stufe von KI-Systemen mit minimalen oder keinem Risiko, das können Dinge wie Spam-Filter oder Videospiele mit KI sein, die zu keinen weiteren Maßnahmen gezwungen werden, hier legt die EU lediglich einen freiwilligen Code of Conduct, also einen Verhaltenskodex nahe, mit dem Ziel so für die eigenen Produkte mehr Vertrauen zu schaffen.

Warum diese Regeln? Was bezweckt die EU mit diesen Vorgaben?

Das wichtigste Ziel des KI-Gesetzes ist es, dass alle Bürgerinnen und Bürger der EU sich in Bezug auf KI sicher fühlen und selbstbewusst mit der neuen Technologie umgehen können. Um das sicherzustellen, werden klare Vorgaben gemacht und Grenzen abgesteckt, die dafür sorgen sollen, dass wir als Menschen die Kontrolle über die Technologie behalten und gerade in wichtigen und entscheidenden Bereichen nicht irgendwann ein Computer für uns entscheiden kann.

Wenn ich mich auf einen Job bewerbe, dann ist es ok, wenn eine KI bei der Vorauswahl unterstützend herangezogen wird, aber sie darf nicht alleine darüber entscheiden, ob ich zu einem Vorstellungsgespräch eingeladen werde oder nicht.

Dasselbe gilt beim Einsatz von KI in Behörden. Hier kann die künstliche Intelligenz definitiv dabei helfen, Prozesse zu beschleunigen und zu optimieren. Aber wichtige Entscheidungen, die signifikante Auswirkungen auf das Leben von einem odermehreren Menschen haben, egal ob es um Aufenthaltsgenehmigungen oder Steuern geht, müssen weiterhin von einem Menschen getroffen werden.

Was bedeutet das für Innovation und den Wirtschaftsstandort Europa?

Gerade, weil die EU hier eben vorgeprescht ist und vor allen anderen Organisationen oder Regierungen entschieden hat, ein Gesetz zu entwickeln stellt sich natürlich die Frage, ob man nicht doch die Innovation ausbremst oder sich einen Nachteil gegenüber beispielsweise Amerika einhandelt, die aktuell weiter ziemlich unkontrolliert die Entwicklung vorantreiben können.

Und auf den ersten Blick scheint das nicht unberechtigt zu sein. Aber das KI-Gesetz und andere Initiativen der EU versuchen eine gute Balance zu finden. Während sinnvollerweise gefährliche und hochriskante Anwendungen verboten oder zumindest streng kontrolliert werden sollen gibt es Unterstützung für kleine und mittlere Unternehmen für die Entwicklung und den Einsatz von KI. Bis zum Jahr 2027 sollen weitere vier Milliarden Euro unter anderem im Rahmen des sogenannten AI Innovation Package als Unterstützung von der europäischen Kommission investiert werden.

Startups, die hier in Europa KI-Systeme entwickeln können, sich sogar darum bewerben, dafür von der EU gestellte Supercomputer zu nutzen, um Kosten zu sparen, oder überhaupt in der Lage zu sein, auf dieser Skala zu arbeiten.

Die Auswirkungen und die Bedeutung von KI für unsere Zukunft werden von der EU nicht unterschätzt und natürlich ist man bestrebt, hier dafür zu sorgen, dass der eigene Wirtschaftsraum nicht abgehängt wird. Gleichzeitig muss die EU aber Regeln vorgeben, um die eigenen Bürgerinnen und Bürger zu schützen, denn die Technologie birgt eben auch Gefahren und Risiken und vor allem bei Menschen, die nicht so tief in der Materie stecken sorgt das natürlich für Verunsicherung.

Das EU KI-Gesetz ist ein Schritt in eine Zukunft, in der künstliche Intelligenz eine immer größere Rolle spielen wird. Es versucht, uns die Vorteile dieser Technologie zu sichern und gleichzeitig die Risiken zu minimieren. Ob das gelingt? Das werden wir in den nächsten Jahren sehen.

Wenn ihr mehr über dieses Thema erfahren wollt, schaut definitiv auf den offiziellen Seiten der EU vorbei. Dort ist alles nochmals ausführlicher dokumentiert und ihr könnt euch ein genaues Bild des KI-Gesetzes mit wirklich allen Details machen.